در دهه چهل و بخصوص دهه پنجاه از قرن بيستم محققان تلاش می کردند که ساختار شبکه های عصبی را با قانون یادگيری کامل کنند. قانون یادگيری یعنی این که پارامترهای شبکه بر اساس ارائه الگوها تنظيم شود. سرانجام فرانك روزنبلات استاد روانشناسی دانشگاه کرنل آمریکا از طریق آناليز ریاضی و شبيه سازی کامپيوتری، نشان داد که نوعی از شبکه های عصبی موسوم به پرسپترون را می توان برای حل مسئله طبقه بندی الگوها آموزش داد. نرونها در این شبکه شبيه نرونهایی بودند که مك کلوث و پيتز ارائه داده بودند.

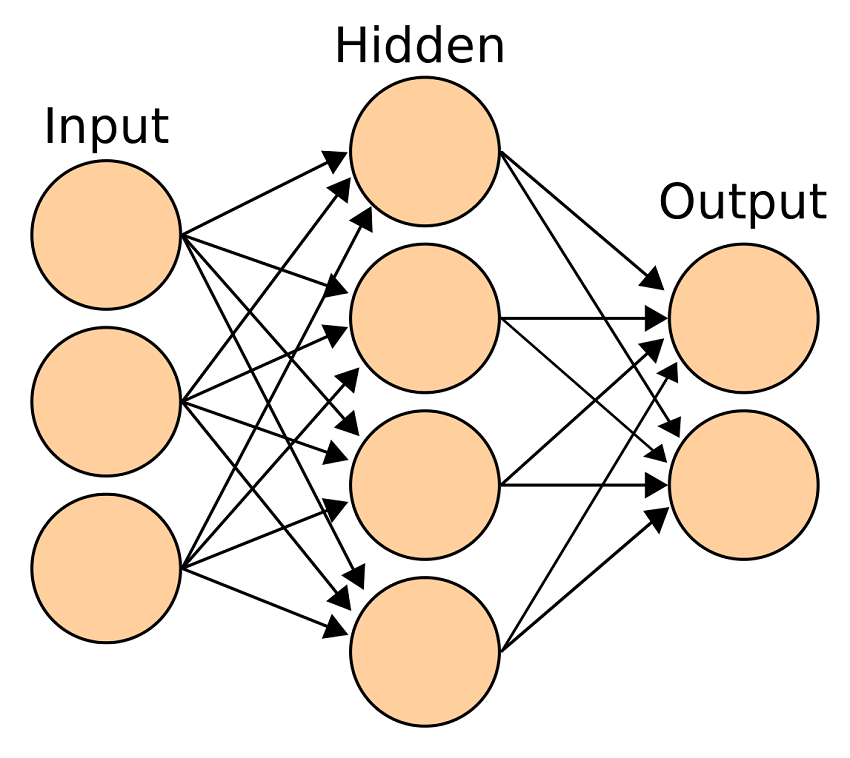

کار مهم روزنبلات در معرفی این شبکه نبود، بلکه ابداع قانون یادگيری برای شبکه پرسپترون بود. او قانون یادگيری ساده و اتوماتيکی را مطرح نمود که قادر بود از هر شرط اوليه که شبکه انتخاب می کرد به جواب مسئله (در صورت وجود) همگرا شود. در اواسط دهه شصت روزنبلات علاقه مند به توصيف بيولوژیکی پروسه فراگيری (تاثير متقابل نرون شناسی و محاسبات مصنوعی نرونی) شد. بطوری که در سال او تلاش می کرد تا توضيح دهد چگونه رشته ای از تجربه های حسی پس از دوره ای از زندگی می توانند به یاد آورده شوند. متاسفانه شبکه پرسپترون روزنبلات از حل بسياری از مسائل و طبقه بندی الگوهایی که در فضای ورود بطور خطی از هم جداناپذیرند، ناتوان بود. در دهه هشتاد قرن بيستم این محدودیتها توسط الگوریتم یادگيری جدیدی مرسوم به پس انتشار خطا، برای شبکه های عصبی پرسپترون چند لایه مرتفع شد.

در این جا برای یادگيری یك نرون، محيط نرون ثابت در نظر گرفته شده است. اما زمانی که یك شبکه عصبی رفتار خود را به شکل اشتراکی، نه بطور مستقل آن گونه که برای یك تك نرون دیدیم تغيير و بهبود می بخشد، هر نرون بردار وزن های متناظر خود را مطابق با قانون یادگيری خاص خودش تغيير می دهد. محيط منبع اطلاعاتی هر نرون در این حالت دیگر ثابت نيست، بلکه با تغيير وزن های نرونهای دیگر تغيير می کند، چون محيط منبع اطلاعاتی یك نرون قائم به ذات نيست، بلکه وابسته به رفتارهای نرونهای دیگر در شبکه است.